DeltaVLM: 基于指令引导的遥感影像交互式变化分析

传统的遥感变化检测方法通常只能输出二值变化图,告诉我们”哪里变了”,却无法回答”发生了什么变化”、”变化程度如何”等更深层的问题。随着视觉语言模型(VLM)的发展,我们是否能让模型像人类分析师一样,以对话的方式灵活地分析遥感影像中的变化?

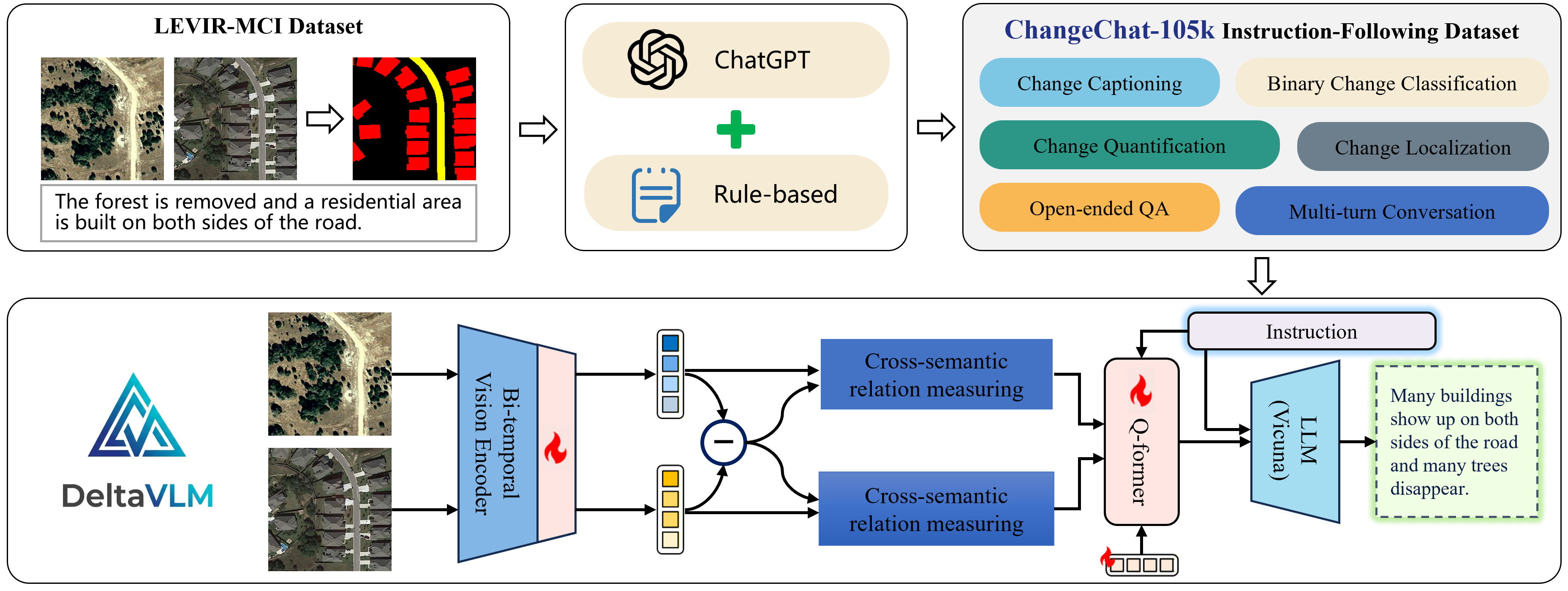

在我们发表于 Remote Sensing 的工作 DeltaVLM (Deng et al., 2026) 中,我们提出了一种基于指令引导的交互式遥感影像变化分析框架,旨在通过自然语言指令驱动模型对双时相影像进行多维度的变化理解。

研究动机

现有的变化检测方法面临以下局限:

- 输出形式单一:仅提供像素级变化掩膜,缺乏语义层面的变化解释

- 缺乏交互能力:无法根据用户的具体需求灵活调整分析维度

- 任务孤立:变化描述、变化分类、变化定位等任务各自独立,缺少统一的解决方案

我们希望构建一个统一的框架,使其能够根据不同的自然语言指令,完成多种变化分析任务。

DeltaVLM 框架

DeltaVLM 的核心架构包含以下关键组件:

双时相视觉编码器

采用 EVA-ViT-g/14 作为视觉骨干网络,分别对前后两个时相的遥感影像进行特征提取,并通过微调最后几层来适应遥感领域的特征分布。

指令引导的差异感知模块

这是 DeltaVLM 的核心创新。该模块包含一个 跨语义关系度量(Cross-Semantic Relation Measuring, CSRM) 机制,能够过滤双时相特征中的无关变化(如光照、季节等干扰因素),聚焦于语义上有意义的变化信息。

指令引导的 Q-Former

在 Q-Former 的基础上引入用户指令信息,使得视觉特征的聚合过程受到指令语义的引导,从而根据不同的查询意图提取不同维度的变化表征。

语言解码器

基于 Vicuna-7B 语言模型,将对齐后的视觉-语义特征解码为流畅的自然语言回复。

ChangeChat-105k 数据集

为训练 DeltaVLM,我们构建了 ChangeChat-105k 数据集,包含约 88k 训练样本和 17k 测试样本,覆盖六种指令类型:

| 任务类型 | 说明 |

|---|---|

| 变化描述 (Change Captioning) | 生成变化区域的文本描述 |

| 二元分类 (Binary Classification) | 判断是否发生变化 |

| 变化量化 (Change Quantification) | 估计变化的程度或范围 |

| 变化定位 (Change Localization) | 识别变化发生的空间位置 |

| 开放问答 (Open-ended QA) | 回答关于变化的任意问题 |

| 多轮对话 (Multi-turn Dialogue) | 围绕变化进行多轮交互 |

数据集通过结合 ChatGPT 生成和基于规则的方法构建,确保了指令的多样性和回答的准确性。

总结

DeltaVLM 将遥感变化检测从”被动检测”推向”交互式理解”,通过统一的视觉语言框架支持多种变化分析任务。该工作为遥感智能分析与大语言模型的结合提供了新的思路。

论文和代码已公开:

- 论文:Remote Sensing

- 代码:GitHub